2025年特朗普上任后,废除了拜登于2023年10月发布的以人工智安全能监管为重点的行政令,免除了政府对人工智能的安全监管。同时,宣布了名为“星际之门”的人工智能基础设施计划,由OpenAI、日本软银集团和Oracle联合发起,预计将在未来四年内投入5000亿美元,用于建设数据中心等关键设施推动AI技术发展。

特朗普的这两个操作,再次突显 人工智能安全与人工智能发展之间的矛盾。而实际上,在这之前,OpenAI从创立到现今,奥特曼的离开、安全主管离职、OpenAI分割为营利和非营利两部门,这一系列的变革的核心问题也是人工智能安全与人工智能发展的矛盾。具体见我之前写的 ,在这篇推文的留言中,我特别记录了OpenAI在后续一系列与安全有关的事件,欢迎大家阅读。

AI安全与发展,谁重要?

AI离不开网络空间,因此我们不妨退后一步,从网络空间安全的角度来看,安全与发展两者的关系一直都是 交缠在一起,两者是 相互促进的。比如,攻击者通过漏洞分析等手段发现了Web数据库应用系统存在注入风险,这直接推动了预编译加强型的Web框架的出现。新框架的出现也必然产生新的漏洞,引来攻击者的关注。所以两者是互补的,互相促进,并非谁重要。

搞人工智能安全的人说安全重要,搞人工智能研发的说发展重要,这其实可能有私利在里面。如果去除私利,他们说的也都没有错。从 网络空间安全的基本规律来看,在某项技术应用的初始阶段,安全往往要让位于发展。而发展到一定时期,隐藏的漏洞不断暴露,这 正如一个人得了很多病,你让他去做一些重体力的活,那显然是要出问题的,容易被坏人攻击,这时候需要放慢脚步做个体检和休整再出发。

人工智能安全观的重要性

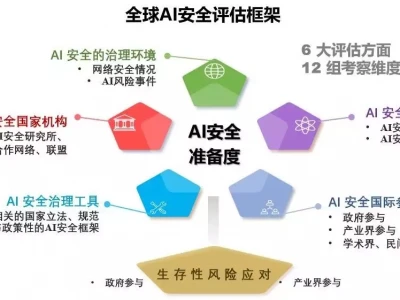

所以我在一书中,提出新的观点--- 人工智能安全观,强调 从网络空间的角度来看待和分析人工智能安全,这样才能全面,不偏颇,可以借鉴网络空间安全许多丰富的经验和观点。只是,本书在第一次印刷时,只在封面上写,过于草率了。所以第二次印刷时,我在第一章增加了一个 定义。不过,安全观的组成当然是一样的。

我们怎么办?

特朗普从商人的角度看,当然是发展,毕竟盈利为首要,这也确实没有错。但是过不了多久,安全必然会光顾特朗普的头脑,因为有人利用AI做坏事,影响社会和国家稳定,这就是政治问题了。所以 发展-->经济, 安全-->政治, 政治经济不可分,大体如此,不管是AI安全或哪个层次的安全。 所以我们国家面对特朗普的操作怎么办,当然是两手抓。返回搜狐,查看更多