AI

格力申请基于卷积神经网络的温度控制专利,提高空调的温度控制准确性历代皇帝的舅舅们北魏汉化前篇,这些舅舅来头不小

hqy 发表于2025-03-01 浏览15 评论0

hqy 发表于2025-03-01 浏览15 评论0

金融界2024年11月2日消息,国家知识产权局信息显示,珠海格力电器股份有限公司申请一项名为“基于卷积神经网络的温度控制方法、装置、空调及介质”的专利,公开号CN 118882192 A,申请日期为2024年9月。

AI

OPPP取得卷积神经网络专利,降低数据处理过程中的运算量并提高数据处理的效率收手吧!“资本家的丑孩子”既无颜值,又无演技,别来祸害观众了

hqy 发表于2025-03-01 浏览16 评论0

hqy 发表于2025-03-01 浏览16 评论0

金融界2024年3月25日消息,据国家知识产权局公告,OPPO广东移动通信有限公司取得一项名为“卷积神经网络、基于卷积神经网络的数据处理方法和装置“,授权公告号CN111415000B,申请日期为2020年4月。

AI

法国国防部长:法国也想要乌克兰的矿产资源

hqy 发表于2025-03-01 浏览11 评论0

hqy 发表于2025-03-01 浏览11 评论0

本文转自【CCTV国际时讯微博】;

乌克兰总统泽连斯基已动身赴美,预计将于当地时间2月28日在华盛顿与美国政府签署矿产协议。而据法国国防部长塞巴斯蒂安·勒科尔尼2月27日接受采访时透露,法国也想要乌克兰的矿产资源,并且自去年10月以来,法国就一直在与乌克兰讨论开采乌克兰矿产以用于法国的国防工业。

AI

“战争可能快结束了,但代价是失去整个国家”

hqy 发表于2025-03-01 浏览13 评论0

hqy 发表于2025-03-01 浏览13 评论0

连日来,美乌围绕矿产协议的谈判引发世界关注。当地时间26日,乌克兰总理表示,乌政府已批准和美国共同开发乌克兰矿产资源协议的最终版本。美国总统特朗普也称,泽连斯基将在28日访美期间签署该协议。

AI

52岁吴越与64岁赵文瑄结婚?刚刚双方回应:坚决抵制“包办婚姻”!

hqy 发表于2025-03-01 浏览17 评论0

hqy 发表于2025-03-01 浏览17 评论0

极目新闻记者 付瞰

2月27日下午,著名女演员吴越在个人社交账号进行“批发式”辟谣,连发数张虚假新闻图,简单利落地回应了与著名男演员赵文瑄的恋情传闻等多个热门假消息。她还安慰一起被“拉下水”的赵文瑄,“咱不闹心哈。”

AI

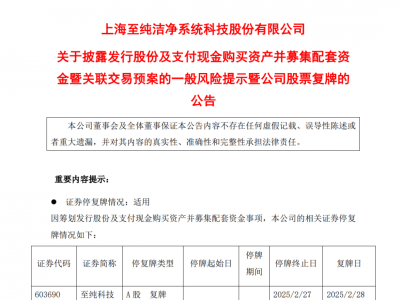

宣布了!百亿A股大动作,明起复牌!5万多股东要嗨?

hqy 发表于2025-03-01 浏览16 评论0

hqy 发表于2025-03-01 浏览16 评论0

【导读】至纯科技拟购买威顿晶磷83.78%股份,股票明起复牌

AI

曼城官方宣布阿根廷王牌正式加盟 目标打造世界级球星

hqy 发表于2025-03-01 浏览14 评论0

hqy 发表于2025-03-01 浏览14 评论0

AI

禁毒不力又甩锅……特朗普扬言对华关税再加10%,对加墨关税3月4日生效

hqy 发表于2025-03-01 浏览13 评论0

hqy 发表于2025-03-01 浏览13 评论0

【文/观察者网 刘程辉】当地时间2月27日,美国总统特朗普宣布,他提议对加拿大和墨西哥加征的关税将于3月4日如期生效。同时他称,对中国商品的关税也将在同一天额外增加10%。这意味着特朗普上任后,美国对华加征关税可能累计将达到20%。

AI

固德威:智慧能源管理系统已接入多种机器学习和深度学习算法清末老照片|有肃亲王的嫡福晋,游玩的溥仪和婉容,土匪与官兵

hqy 发表于2025-03-01 浏览12 评论0

hqy 发表于2025-03-01 浏览12 评论0

金融界2月20日消息,有投资者在互动平台向固德威提问:请问贵司智慧能源管理平台是否接入AI,后续是否考虑部署deepseek来实现实现公司AI能源赋能。

AI

探秘深度学习与自然语言处理:常见的微调策略全解析!第7次海试开始!福建舰一处细节引关注,五角大楼发现情况不妙

hqy 发表于2025-03-01 浏览14 评论0

hqy 发表于2025-03-01 浏览14 评论0

在深度学习和自然语言处理领域,常见的微调方法主要有以下几种:

全参数微调(Fine-tuning):这是最为传统的微调方式。它需要对预训练模型中的所有参数进行更新,以此来适应特定的任务。这种方法往往能够取得最佳性能,不过其计算成本相对较高。 提示微调(Prompt-tuning):该方法通过精心设计特定的输入提示(prompts),而不是去修改模型的权重,来使模型适应下游任务。这样能让模型在计算成本较低的情况下,适应各种各样的任务。 参数高效微调(Parameter-efficient fine-tuning):这组方法的核心在于,只对模型参数的一个子集或者新添加的一组参数进行训练,目的是减少所需的参数数量以及计算资源。对于那些资源有限的环境而言,这些技术有着至关重要的意义。 适配器训练(Adapter Training):适配器是一种添加到预训练模型中的小型神经网络,主要用于特定任务的微调。这些适配器仅仅占据原始模型大小的一小部分,所以训练速度更快,而且内存需求也更低。 渐进收缩(Progressive Shrinking):这种技术是在微调期间,逐渐减小预训练模型的规模,最终得到一个比从头开始训练性能更好的小型模型。 前缀微调(Prefix Tuning):它涉及学习特定任务的连续提示,并在推理过程中将其添加到输入之前。通过对这个连续提示进行优化,模型就能适应特定任务,且无需修改底层模型参数。 P-Tuning:主要涉及对可学习的“提示记号”参数进行训练,这些参数会与输入序列相连接。这些提示记号是特定于任务的,在微调过程中会被优化,使得模型能够在保持原始模型参数不变的情况下,在新任务上有良好的表现。