AI

甜啦啦x蜡笔小新,「动感摇摇杯系列」摇趣上市

hqy 发表于2025-06-30 浏览26 评论0

hqy 发表于2025-06-30 浏览26 评论0

6月27日,甜啦啦官宣与动漫IP《蜡笔小新》达成跨界合作,推出动感摇摇杯系列。本次联名以“果真超开‘新’,摇摇更尽兴”为主题,不仅带来三款限定饮品,更以魔法变色杯贴、定制摇摇杯、光栅透扇等创意周边带来全新茶饮体验——当消费者轻摇杯身,杯贴上的文字将发生变色,喝奶茶瞬间变身沉浸式互动游戏。

AI

深度学习和自然语言处理领域,常见的微调方法有哪些?女人在这4件事上不拒绝你,摆明了对你有好感!

hqy 发表于2025-06-30 浏览23 评论0

hqy 发表于2025-06-30 浏览23 评论0

在深度学习和自然语言处理领域,常见的微调方法主要包括以下几种:

Fine-tuning(全参数微调)

AI

深度学习与自然语言处理:常见的微调方法有哪些?三亚身亡女生尸检死因曝光,家属说谎被官方打脸,更多细节披露

hqy 发表于2025-06-30 浏览17 评论0

hqy 发表于2025-06-30 浏览17 评论0

在深度学习和自然语言处理领域,常见的微调方法主要包括以下几种:

Fine-tuning(全参数微调):这是最传统的微调方法,涉及更新预训练模型中的所有参数,以适应特定任务。这种方法通常能够获得最好的性能,但计算成本较高。 Prompt-tuning(提示微调):这种方法通过设计特定的输入提示(prompts),而不是修改模型的权重,来适应下游任务。它允许模型在计算成本较低的情况下适应各种任务。 Parameter-efficient fine-tuning(参数高效微调):这组方法旨在通过仅训练模型参数的一个子集或新添加的一组参数,以减少所需的参数和计算资源。这些技术对于资源有限的环境非常重要。 Adapter Training(适配器训练):适配器是添加到预训练模型中的小型神经网络,用于特定任务的微调。这些适配器只占原始模型大小的一小部分,使得训练更快,内存需求更低。 Progressive Shrinking(渐进收缩):这种技术涉及在微调期间逐渐减小预训练模型的大小,从而产生比从头开始训练的模型性能更好的小型模型。 Prefix Tuning(前缀微调):涉及学习特定任务的连续提示,在推理过程中将其添加到输入之前。通过优化这个连续提示,模型可以适应特定任务而不修改底层模型参数。 P-Tuning:涉及训练可学习的称为“提示记号”的参数,这些参数与输入序列连接。这些提示记号是特定于任务的,在微调过程中进行优化,使得模型可以在保持原始模型参数不变的情况下在新任务上表现良好。AI

北自所申请基于自然语言处理的自动拣选方法、装置及存储介质专利,提高拣选效率不需要你的歌来帮我催眠

hqy 发表于2025-06-30 浏览35 评论0

hqy 发表于2025-06-30 浏览35 评论0

金融界2024年11月28日消息,国家知识产权局信息显示,北自所(北京)科技发展股份有限公司申请一项名为“一种基于自然语言处理的自动拣选方法、装置及存储介质”的专利,公开号 CN 119026599 A,申请日期为 2024 年 8 月。

AI

探索深度学习与自然语言处理:常见微调技巧揭秘身姿妙曼的气质美女身材白色休闲西裤展示完美身材,女人味十足

hqy 发表于2025-06-30 浏览24 评论0

hqy 发表于2025-06-30 浏览24 评论0

在深度学习以及自然语言处理的领域中,常见的微调方法主要包含以下几种:

Fine-tuning(全参数微调):作为最为传统的微调方法,它需要对预训练模型里的所有参数进行更新,以此让模型能够适应特定的任务。这种方法通常能获取到最佳性能,不过其计算成本相对较高。 Prompt-tuning(提示微调):该方法通过精心设计特定的输入提示(prompts),而非修改模型权重的方式来使模型适配下游任务。如此一来,模型能够在计算成本较低的情况下适应各种各样的任务。 Parameter-efficient fine-tuning(参数高效微调):这组方法的核心在于仅对模型参数的一个子集或者新添加的一组参数展开训练,目的是减少所需的参数量以及计算资源。对于资源有限的环境而言,这些技术显得尤为重要。 Adapter Training(适配器训练):适配器属于添加到预训练模型中的小型神经网络,用于针对特定任务展开微调工作。由于这些适配器仅仅占据原始模型大小的一小部分,所以训练速度更快,同时内存需求也更低。 Progressive Shrinking(渐进收缩):此技术在微调期间会逐渐缩小预训练模型的规模,进而打造出比从头开始训练的模型性能更优的小型模型。 Prefix Tuning(前缀微调):主要是学习特定任务的连续提示,在推理过程中将其添加至输入之前。通过对该连续提示进行优化,模型能够在不修改底层模型参数的前提下适应特定任务。 P-Tuning:涉及对可学习的“提示记号”参数展开训练,这些参数与输入序列相连接。这些提示记号是具有任务特异性的,在微调过程中对其进行优化,使得模型可以在保持原始模型参数不变的情况下,在新任务上有着良好的表现。

AI

探索深度学习与自然语言处理:常见的微调策略揭秘哇!53岁袁立现身巴黎又瘦又美难辨认,小11岁老公相伴超幸福

hqy 发表于2025-06-30 浏览18 评论0

hqy 发表于2025-06-30 浏览18 评论0

在深度学习与自然语言处理领域,常见的微调方法主要包含以下几种:

Fine-tuning(全参数微调):作为最传统的微调方法,它需要对预训练模型中的所有参数进行更新,以此来适应特定任务。该方法通常能取得最佳性能,不过其计算成本相对较高。 Prompt-tuning(提示微调):此方法通过精心设计特定的输入提示(prompts),而非修改模型权重,来使模型适应下游任务。这样能使模型在计算成本较低的情况下适应各类任务。 Parameter-efficient fine-tuning(参数高效微调):这组方法主要是通过仅训练模型参数的一个子集或者新添加的一组参数,以此减少所需的参数数量以及计算资源。对于资源有限的环境而言,这些技术意义重大。 Adapter Training(适配器训练):适配器是一种添加到预训练模型中的小型神经网络,用于针对特定任务进行微调。这些适配器仅占原始模型大小的一小部分,从而使得训练速度更快,内存需求也更低。 Progressive Shrinking(渐进收缩):该技术在微调过程中会逐渐减小预训练模型的大小,进而产生比从头开始训练的模型性能更优的小型模型。 Prefix Tuning(前缀微调):这种方法涉及学习特定任务的连续提示,并在推理过程中将其添加在输入之前。通过对这个连续提示进行优化,模型能够在不修改底层模型参数的情况下适应特定任务。 P-Tuning:此方法涉及对可学习的“提示记号”参数进行训练,这些参数与输入序列相连。这些提示记号具有任务特异性,在微调过程中对其进行优化,从而使模型在保持原始模型参数不变的情况下,在新任务上有良好的表现。

AI

探秘深度学习与自然语言处理:常见的微调策略全解析!哇 我又发现了一件好看的连衣裙|小个子穿搭

hqy 发表于2025-06-30 浏览27 评论0

hqy 发表于2025-06-30 浏览27 评论0

在深度学习和自然语言处理领域,常见的微调方法主要有以下几种:

全参数微调(Fine-tuning):这是最为传统的微调方式。它需要对预训练模型中的所有参数进行更新,以此来适应特定的任务。这种方法往往能够取得最佳性能,不过其计算成本相对较高。 提示微调(Prompt-tuning):该方法通过精心设计特定的输入提示(prompts),而不是去修改模型的权重,来使模型适应下游任务。这样能让模型在计算成本较低的情况下,适应各种各样的任务。 参数高效微调(Parameter-efficient fine-tuning):这组方法的核心在于,只对模型参数的一个子集或者新添加的一组参数进行训练,目的是减少所需的参数数量以及计算资源。对于那些资源有限的环境而言,这些技术有着至关重要的意义。 适配器训练(Adapter Training):适配器是一种添加到预训练模型中的小型神经网络,主要用于特定任务的微调。这些适配器仅仅占据原始模型大小的一小部分,所以训练速度更快,而且内存需求也更低。 渐进收缩(Progressive Shrinking):这种技术是在微调期间,逐渐减小预训练模型的规模,最终得到一个比从头开始训练性能更好的小型模型。 前缀微调(Prefix Tuning):它涉及学习特定任务的连续提示,并在推理过程中将其添加到输入之前。通过对这个连续提示进行优化,模型就能适应特定任务,且无需修改底层模型参数。 P-Tuning:主要涉及对可学习的“提示记号”参数进行训练,这些参数会与输入序列相连接。这些提示记号是特定于任务的,在微调过程中会被优化,使得模型能够在保持原始模型参数不变的情况下,在新任务上有良好的表现。AI

金现代:公司人工智能的研究方向主要包括大语言模型、自然语言处理等AI技术彻底混不下去了!官方通报不到72小时,那尔那茜再迎4个噩耗

hqy 发表于2025-06-30 浏览19 评论0

hqy 发表于2025-06-30 浏览19 评论0

证券之星消息,金现代(300830)06月11日在投资者关系平台上答复投资者关心的问题。

投资者:董秘你好,请问公司是否提供定制化AI产品服务(甲方提供数据,金现代训练调教出成品AI直接供甲方使用)。

AI

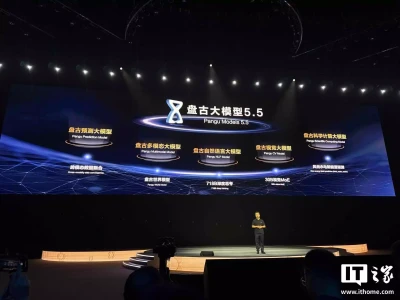

华为云发布盘古大模型 5.5:自然语言处理等五大基础模型全面升级以色列军工企业公开击沉中国054A军舰,外交部当场精准亮剑

hqy 发表于2025-06-30 浏览30 评论0

hqy 发表于2025-06-30 浏览30 评论0

IT之家 6 月 20 日消息,在今日下午的华为开发者大会 HDC 2025 主题演讲中,华为常务董事、华为云计算 CEO 张平安正式发布盘古大模型 5.5,自然语言处理(NLP)、计算机视觉(CV)、多模态、预测、科学计算五大基础模型全面升级。

AI

谷歌申请在减少日程表相关交互的程度中使用大型语言模型专利,处理日程表数据生成自然语言表示

hqy 发表于2025-06-30 浏览34 评论0

hqy 发表于2025-06-30 浏览34 评论0

本文源自:金融界

金融界2025年6月24日消息,国家知识产权局信息显示,谷歌有限责任公司申请一项名为“在减少日程表相关交互的程度中使用大型语言模型”的专利,公开号CN120202479A,申请日期为2022年12月。