深度学习正在改变机器理解和处理复杂数据的方式。它模仿人类大脑的神经网络,使计算机能够从海量的非结构化数据中自主发现模式,并做出明智的决策。

一、深度学习的工作原理?

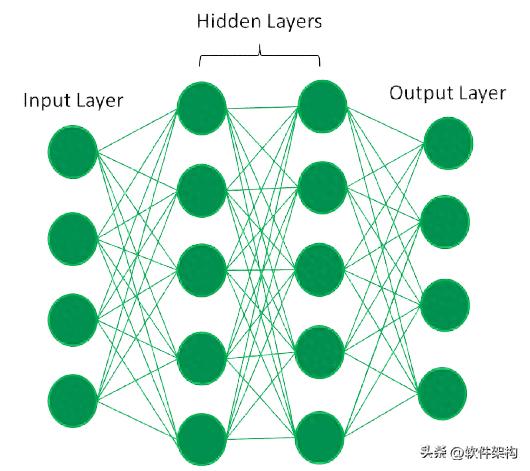

神经网络由多层相互连接的节点或神经元组成,这些节点协同处理输入数据。在全连接深度神经网络中,数据通过多个层级流动,每个神经元执行非线性变换,使模型能够学习数据的复杂表示。

专栏

Spring AI MCP开发示例

作者:软件架构

9.9币

0人已购

查看

在深度神经网络中,输入层接收数据,数据通过隐藏层进行非线性函数变换,最终由输出层生成模型的预测结果。

二、神经架构的演变

深度学习的旅程始于感知机(Perceptron),这是一种在20世纪50年代引入的单层神经网络。尽管感知机具有创新性,但它只能解决线性可分问题,因此在更复杂的任务上失败。

这一局限性促使了多层感知机(MLPs)的开发。它引入了隐藏层和非线性激活函数。通过反向传播训练的MLPs能够建模复杂的非线性关系,标志着神经网络能力的重大飞跃。从感知机到MLPs的演变,为卷积神经网络(CNNs)和循环神经网络(RNNs)等高级架构奠定了基础,展示了分层结构在解决现实世界问题中的强大能力。

神经网络的类型

前馈神经网络(FNNs):这是最简单的ANN类型,数据从输入到输出单向流动。它用于基本任务,如分类。卷积神经网络(CNNs):专门用于处理网格状数据,如图像。CNNs使用卷积层来检测空间层次结构,使其成为计算机视觉任务的理想选择。循环神经网络(RNNs):能够处理序列数据,如时间序列和自然语言。RNNs通过循环结构保留信息,从而实现语言建模和语音识别等应用。其变体如LSTM和GRU解决了梯度消失问题。生成对抗网络(GANs):由两个网络组成——生成器和判别器,它们相互竞争以生成逼真的数据。GANs广泛用于图像生成、风格转换和数据增强。自编码器(Autoencoders):这是一种无监督网络,用于学习高效的数据编码。它们将输入数据压缩到潜在表示中,并重新构建它,适用于降维和异常检测。Transformer网络:它通过自注意力机制彻底改变了自然语言处理(NLP)。Transformer在翻译、文本生成和情感分析等任务中表现出色,为GPT和BERT等模型提供了支持。随着我们不断突破计算能力和数据集规模的限制,深度学习的潜在应用几乎是无限的。深度学习有望重塑我们的未来,让机器能够以我们难以想象的规模和速度学习、适应并解决复杂问题。

专栏

PyTorch深度学习零基础入门

作者:软件架构

19.9币

32人已购

查看